Resumo

- Os criadores do YouTube agora são obrigados a divulgar quando usam IA generativa para alterar o conteúdo para maior clareza dos espectadores.

- O conteúdo sinalizado inclui imagens alteradas de pessoas ou eventos que não ocorreram, para distinguir fatos de ficção.

- Os rótulos de divulgação de IA terão mais destaque em tópicos específicos como saúde, notícias, eleições ou conteúdo financeiro.

À medida que a IA continua a penetrar nas aplicações e serviços do Google, a empresa está a tomar medidas para garantir que os utilizadores compreendem o seu impacto. O YouTube, plataforma de streaming de vídeo de propriedade do Google, tem uma infinidade de criadores que estão começando a aproveitar a IA para conteúdo. Agora, a gigante da tecnologia está promulgando políticas para garantir que os espectadores possam diferenciar os fatos da ficção ao usar o YouTube.

Luzes, câmera, polêmica: como o YouTube evoluiu desde seu lançamento em 2005

Vamos explorar todos os altos e baixos do YouTube nos últimos 19 anos

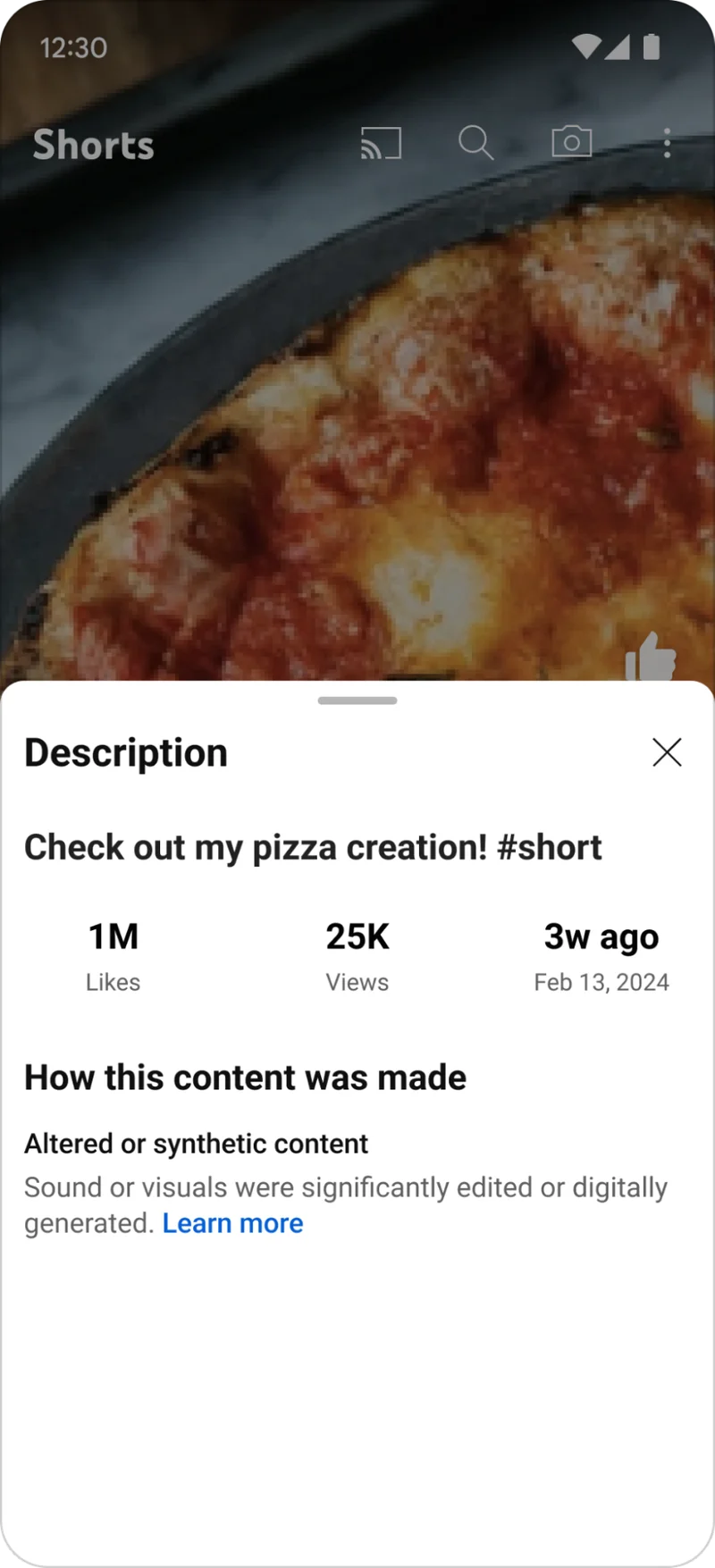

Em um anúncio publicado na página de ajuda do YouTube, o Google afirma que está lançando uma nova ferramenta que exigirá que os criadores do YouTube especifiquem quando usaram IA generativa para criar conteúdo. As informações são então exibidas na descrição expandida do conteúdo, onde os espectadores podem aprender como o que estão vendo foi alterado.

O conteúdo que deve ser sinalizado inclui qualquer coisa que faça uma pessoa dizer ou fazer algo que realmente não aconteceu, bem como imagens alteradas de um evento ou lugar real. Uma cena realista que não ocorreu, mas parecia ter acontecido via IA, também deve ser divulgada. O rótulo no conteúdo sintético pode indicar que o som ou as imagens foram “significativamente editados ou gerados digitalmente”.

Nem todo conteúdo com IA exige um rótulo

Embora possa ser fácil ignorar essas notificações em uma descrição expandida, o Google observou que isso tornará esses avisos mais proeminentes no conteúdo sobre tópicos específicos. Por exemplo, os vídeos do YouTube que abordam saúde, notícias, eleições ou questões financeiras terão um rótulo de divulgação de IA mais óbvio. No entanto, alguns conteúdos não precisarão ser rotulados para inclusão de IA – o uso de filtros de iluminação ou efeitos especiais de fundo não precisa ser divulgado. Os criadores também não precisam sinalizar o conteúdo se a IA for usada para questões de produção, como geração de scripts. O Google diz que se as alterações de IA no conteúdo forem “inconsequentes”, relatar esses ajustes não é essencial.

À medida que a Google continua a desviar mais atenção para as suas iniciativas de IA, está a abordar o impacto da tecnologia em mais do que apenas o YouTube. Em 2023, por exemplo, os desenvolvedores de aplicativos Android foram solicitados a começar a sinalizar conteúdo potencialmente ofensivo gerado por IA. Parece que a empresa acredita que um esforço coletivo é a forma mais eficaz de moderar o novo cenário gerado pela IA.