OpenAI, os humanos que criaram manchetes, responsáveis pela ascensão do ChatGPT e por muita conversa sobre LLMs (grandes modelos de linguagem), revelaram sua última criação, Microscope, uma interface de visualização neural bacana. Ao contrário dos pacotes de software de natureza mais familiar, o OpenAI Microscope é uma ferramenta orientada para o desenvolvedor. Não se destina às massas.

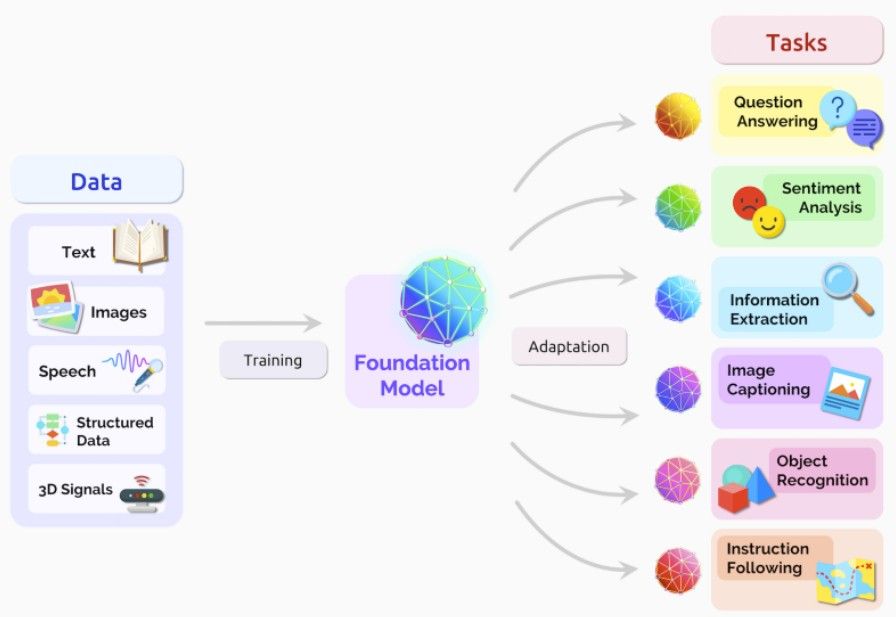

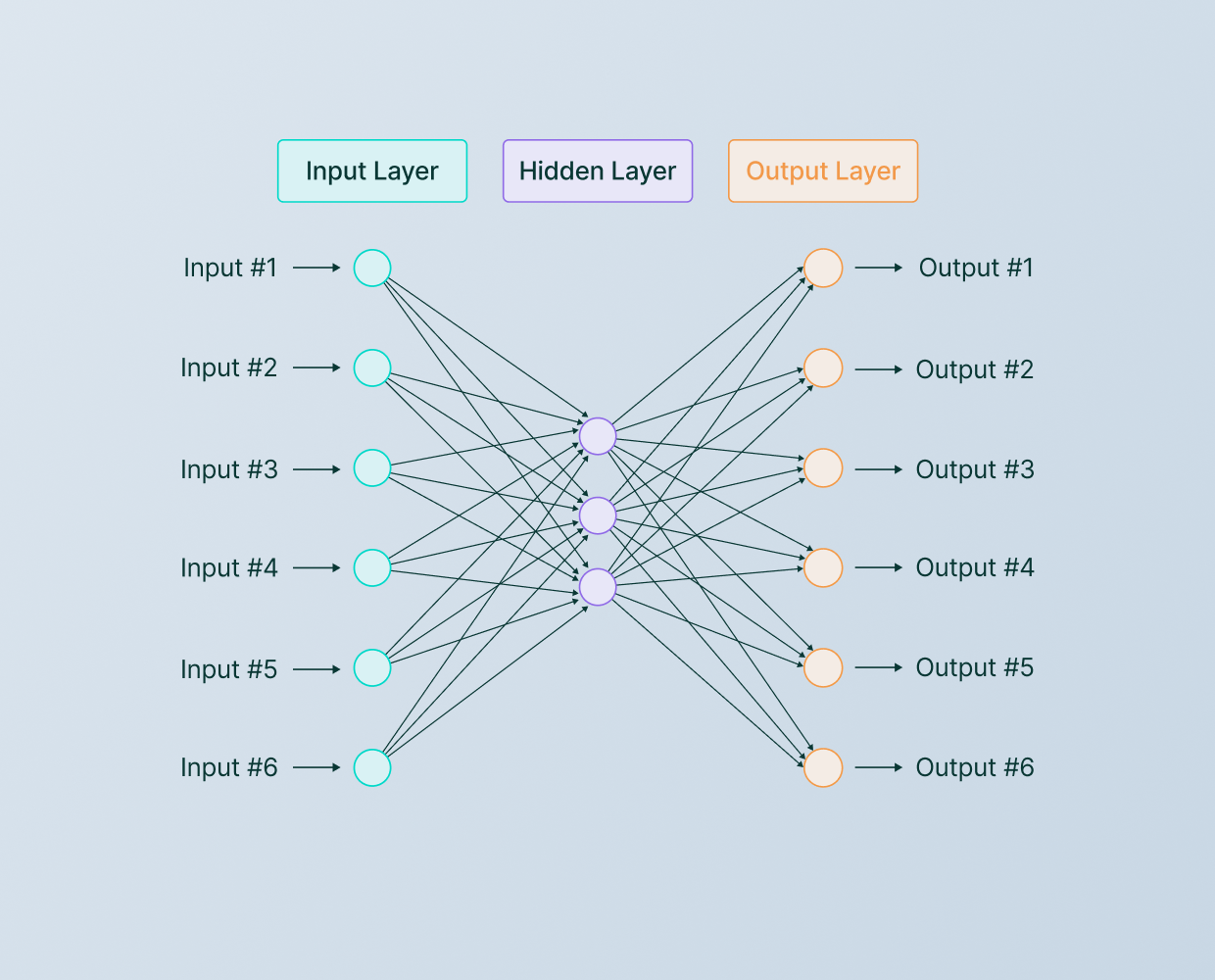

O aplicativo baseado na web visualiza redes neurais como organismos metafóricos em camadas. LLMs usam essas redes neurais como blocos de construção. Ao navegar no aplicativo da web, os usuários interagem com as visualizações, veem como as redes neurais são manipuladas e obtêm insights sobre como o funcionamento interno dos modelos de IA percebe e processa dados de imagem.

Desvendando os mistérios da análise do modelo LLM

Há um sentimento distinto entre os membros da comunidade de IA de que mesmo os engenheiros de software da OpenAI não entendem completamente as maquinações internas de seus modelos de IA. Além de ser um pensamento preocupante, evoca pensamentos de uma enigmática caixa preta. Sabemos que os modelos funcionam. Não sabemos por que eles executam seus processos semelhantes aos humanos.

Lançando alguma luz sobre suas funções, o OpenAI Microscope examina os enormes conjuntos de dados e interpreta o código como atividade neural. Ele divide essas operações extremamente complexas em componentes digeríveis, permitindo aos pesquisadores entender melhor como funcionam os modelos de IA.

Fonte: AIMultiple

Camadas visualizadas por imagem são construídas em cadeias de processamento, que revelam as técnicas de aprendizagem profunda usadas para treinar as redes neurais subjacentes aos grandes modelos de linguagem e formatar uma interação. Observe como palavras como neurônios e microscópios são utilizadas pela OpenAI, não pelo código subjacente ou pelas bibliotecas de dados. O objetivo parece ser desmistificar os modelos para que sejam percebidos como organismos.

Resumindo, OpenAI Microscope é um aplicativo baseado na web com orientação visual e foco acadêmico.

Clique, explore, entenda as redes neurais

Além de emprestar termos das ciências naturais, a interface da web elimina linguagem que só seria compreensível para uma subseção restrita de entusiastas da IA. Dessa forma, a análise dos modelos fica mais acessível tanto para especialistas quanto para não especialistas.

Fonte: Laboratórios V7

Navegando na página Microscópio, hospedada pela OpenAI, os blocos de construção dividem as camadas interpretadas visualmente de cada modelo em nós. Esses nós são clicáveis. Passe o mouse sobre qualquer um deles e mergulhe mais fundo nas atividades de uma rede neural. Por exemplo, clicar na miniatura do Alexnet (uma publicação do NIH) leva a uma configuração nodal de assinatura exclusiva. Clicar em qualquer um desses nós leva o explorador da rede neural mais fundo.

Dessa forma, visualizações neurais são usadas para relacionar recursos do conjunto de dados. Imagens de amostra, nas quais a rede treinou, são mapeadas e exibidas para que os usuários obtenham contexto. Embora seja verdade que tudo isso parece um pouco abstrato, para dizer o mínimo, o mapeamento é organizado de forma lógica e identificável, para que os desenvolvedores possam inferir o processo de tomada de decisão de uma determinada rede neural seguindo os nós.

Ao analisar as atividades da rede neural em cada nó, os desenvolvedores obtêm insights sobre como a rede reconhece e interpreta diferentes recursos no conjunto de dados. No caso do AlexNet, suas funcionalidades são baseadas no reconhecimento e processamento de imagens. Para outra rede, digamos CLIP Resnet 50 4x, trata-se de legendas de texto interpretadas contextualmente em imagens específicas, portanto, o reconhecimento de imagem está na mistura novamente.

Os desenvolvedores podem se aprofundar nas redes neurais usando o OpenAI Microscope e ver como vários nós se conectam e interagem.

Desmistificando as caixas pretas dos modelos de IA

O significado dessas camadas neurais é indefinido, pelo menos para a maioria dos visitantes do site. Ele foi projetado para ser interpretado por pesquisadores, especialmente aqueles em inteligência artificial (IA). Os pesquisadores de interpretabilidade usam o microscópio OpenAI focando uma lente “técnica” em uma camada de uma rede neural específica. Existem, pela última contagem, 13 deles. Vamos nos aprofundar em um dos modelos de visão:

- Abra o site do microscópio OpenAI. As tags anexadas à página da web são Interoperabilidade, Visão Computacional e Liberação. Clicar neles leva a um Índice de Pesquisa, mais uma prova de que este é um playground para pesquisadores.

- Role para baixo para ler uma sinopse de como os modelos de visão conectáveis interagem como milhares e milhares de neurônios metafóricos. Existem também links para a Lucid Library e o Circuits Project, que geram as visualizações e examinam as conexões neurais, nessa ordem.

- Vá para a página Modelos de microscópio OpenAI para acessar os modelos e as ferramentas usadas para examinar seus recursos.

- A coleção de 13 modelos de visão computacional é selecionada aqui e apresentada como uma interface logicamente acessível que responde instantaneamente a um clique do mouse.

- Os pesquisadores podem detalhar a estrutura nodal para ver como os neurônios em uma camada visualizada interagem.

- Depois de clicar em um nó, a visão amplia as unidades internas. As lentes selecionadas são listadas como “técnicas” no painel esquerdo da tela. Essas técnicas interpretam artificialmente conjuntos de dados multidimensionais ou agrupam conjuntos de imagens bidimensionais nas quais os modelos foram treinados.

Compreender como essas enigmáticas redes neurais se conectam e “pensam” é como tentar entender como funciona o cérebro humano. É um desafio formidável, que é melhor deixar para pesquisadores de aprendizado de máquina e para aqueles especializados em áreas de estudo como a neurociência cognitiva. A OpenAI fez bem ao criar um conjunto de visualizações selecionadas dessas fatias de inteligência de máquina orientadas visualmente.

O Microscópio OpenAI é uma análise ilustrativa do aprendizado de máquina, uma forma de representar conjuntos de dados complexos como imagens. A “biologia” dos modelos de visão populares amplia os neurônios dentro da arquitetura nodal para que pesquisadores de IA superinteligentes possam interpretar as conexões e a ponderação que ocorrem entre as camadas. Para contextualizar, imagine o Bing Image Creator respondendo aos prompts de forma mais natural devido a uma melhor compreensão dessas conexões.

Ao comparar o funcionamento das redes neurais com o do cérebro humano, os investigadores esperam desbloquear insights notáveis sobre os mistérios da inteligência artificial. Isso significa que investigar essas caixas pretas de IA provavelmente afetará nossa compreensão do cérebro humano. Através deste trabalho, estamos cada vez mais perto de desvendar os segredos da mente e de desenvolver as capacidades da inteligência artificial.